Pick up News

About the Project

何をやるのか

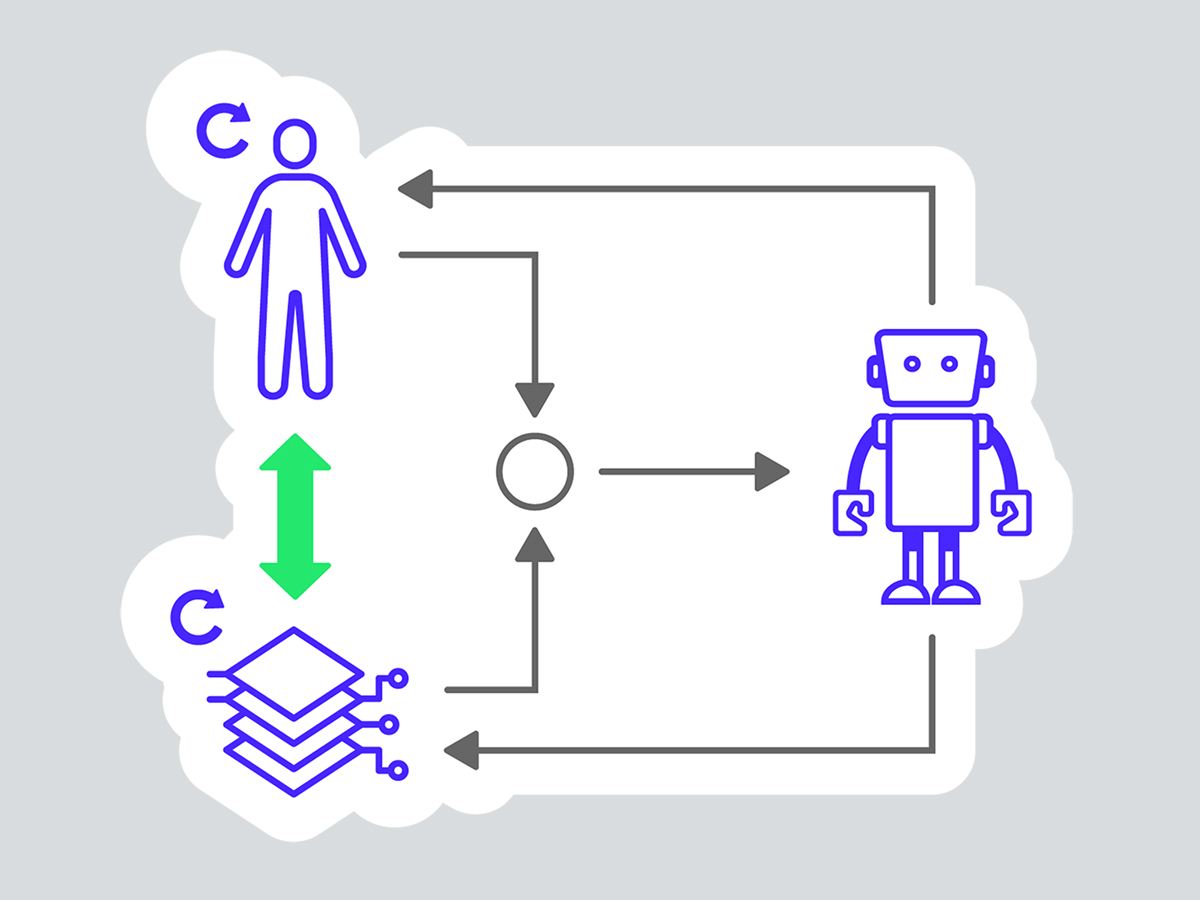

本プロジェクトでは、脳波を含むマルチモーダル計測に基づく技能抽出、および人とAIが一つのロボットを協調操作する身体融合を介したインタラクティブな学習を通じ、技能者からロボットへ高度技能をインストールする身体融合学習基盤の創出を目的としています。「技能者が持つ特有の感覚運動情報」と「人―AI身体相互モデル」を明らかにし、これらを実装した学習アーキテクチャを構築して、ロボットによる複数の高度技能の実現を目指します。

どうやってやるのか

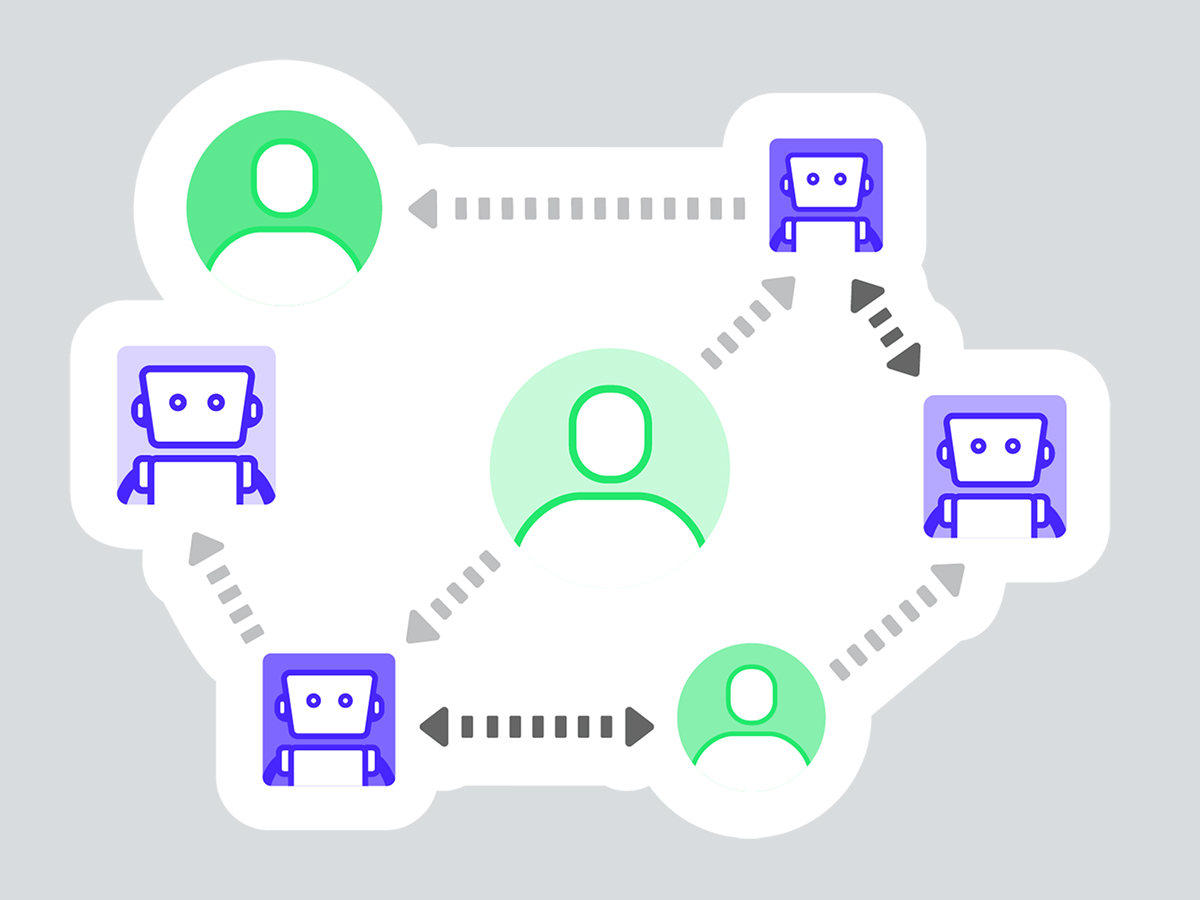

「身体融合学習」は、人とAIが協調的に学ぶ新しいAI学習の枠組みです。人とAIの動きを統合してロボットに反映させ、協調操作を通じて学習を進めます。人は無意識にAIの動作に介入し、AIは人やロボットの状態を推定する内部モデルを持つことで、人に適応しながら学習を行います。人とAIが相互に影響し合うインタラクティブな学習系を通じて、身体の違いを包摂し、暗黙的な身体知のトランスファーの実現を目指します。

こんな世界をつくりたい

高齢化による技能伝承の困難さや生産年齢人口の減少は、技能の持続的発展も阻害しています。本来、高度技能は属人的で、その組み合わせや変化が新たな技能を生んできました。身体融合学習による技能のトランスファーは人からロボットに加え、ロボットから人、ロボットからロボットへと発展します。「自ら学ぶAI」と「人」が技能を互いに共進化する仕組みに基盤を拡張し、多様な技能がロボット・人に創発される社会を目指しています。

PI Message

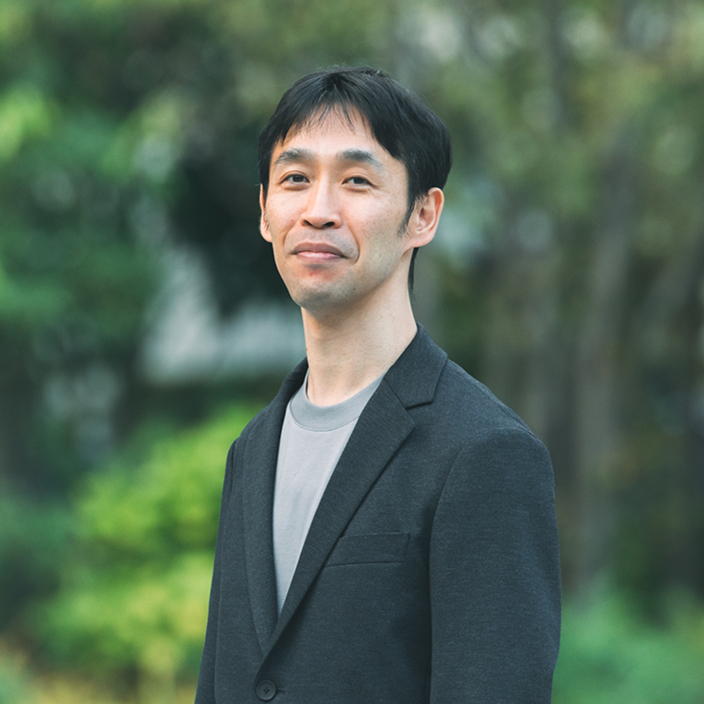

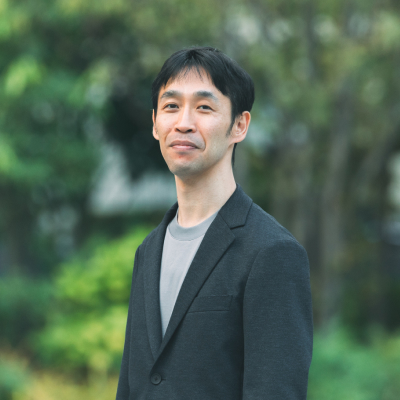

田中 由浩

Yoshihiro Tanaka

名古屋工業大学 教授

身体が違えば、同じ対象でも運動や感覚は異なります。特に触覚は、身体と環境との相互作用によって生じるため、言語化や共有が本質的に難しい感覚です。一方で人は、運動と感覚に基づく多様な経験を通じて技能や感性を磨いてきました。 本プロジェクトでは、属人的で言語化が難しい高度な技能をロボットに学習させる方法論の構築に挑みます。 鍵となるのは、一つのロボットを複数人で協調操作する「身体融合」です。身体融合では、共通の目標のもと、意識的・無意識的な身体的相互介入が生まれます。これを技能者とAIの協調へと拡張し、言語化が難しい高度技能をインタラクティブにAIへ伝達することで、高度な技能を発揮できるロボットの実現を目指します。 触覚、ロボット、AI、VR、脳科学など多様な分野の研究者に加え、現場の技能者と連携して研究を進めます。様々な分野の方々とともに、身体知やものづくりにおける人とロボットの共生を探究し、多様な技能が創発される社会の構築につなげます。

Group

技能解析Group

マルチモーダル計測・提示による技能抽出

脳波を含むマルチモーダルの計測を通じた技能抽出手法を構築し、身体融合学習を通じた技能獲得の評価と技能の体系化を進めます。また、身体融合状態で直感的な操作を可能とする感覚運動共有インタフェースを開発します。

Member

小田桐 匡

Masashi Odagiri

京都橘大

基礎理論Group

身体融合学習インタラクションモデルの構築

身体融合状態における人とAI間の情報フローと相互作用を記述する認知科学的・工学的モデルを構築します。加えて、このモデルに基づき、学習を効率化・ロバスト化する介入手法を明らかにし、人とAI、あるいはAI同士が能力を高め合う「共進化」プロセスを実証します。

Member

学習構造Group

身体融合学習アーキテクチャの確立

開発したインタフェースや技能パターンを学習に導入する手法と、人−AI相互モデルに基づき、身体融合学習におけるロボットへの介入を適切に制御する手法を構築します。さらに、ロボットに実装して高度技能を実現し、学習効率や成功率を検証します。